蚂蚁百灵开卷模型性价比! 长文本推理只要1/10成本

作者|江宇

智东西9月26日报道,蚂蚁百灵团队近日正式开源两款全新混合线性推理模型——Ring-mini-linear-2.0与Ring-flash-linear-2.0。相比前代,这一轮升级在延续高稀疏MoE结构的基础上,引入了混合线性注意力(LinearAttention)机制,专为长文本、低成本推理等场景提效而设计。

眼下,大模型开始真正走进应用场景,推理成本却成了横在企业面前的一道坎。一边是用户希望更快、更久地交互,另一边却是又贵又慢的模型部署现实。在不牺牲效果的前提下降本提效,已经成了各家模型团队绕不开的问题。

据蚂蚁团队的实测数据,在保持SOTA精度的前提下,本轮开源的Ring-linear系列模型最大上下文长度512k,将推理成本压缩至dense模型的1/10,相比原有Ring模型推理成本降低50%以上,并且在高并发解码任务中吞吐量可达Qwen3-8B的12倍、Qwen3-32B的10倍以上。

此外,蚂蚁团队还引入了精细化的推理优化融合算子、RL训练对齐机制等系统级工具,直指当前推理成本与训练稳定性的关键瓶颈。

除了推理效率的显著提升,Ring-linear系列模型在多项标准评测中的表现也不容忽视,尤其在数学推理、结构代码生成、通用语言理解与写作任务中,展现出与主流大模型相比具有竞争力的准确率。实测结果包括:

Ring-mini-linear-2.0:

Ring-flash-linear-2.0:

目前,这套模型现已同步上线多平台,开源地址如下:

一、混合线性架构重构Attention计算图,推理成本再砍一半

此次开源的Ring-linear系列模型,构建于蚂蚁自研的Ring-mini-2.0与Ring-flash-2.0MoE基座之上,最大特点是将主干Attention模块替换为自研线性Attention融合模块,辅以少量标准Attention,形成高效混合注意力结构。

以Ring-flash-linear为例,其结构中87.5%的层采用线性Attention(28层线性+4层标准),结合旋转位置编码(RoPE)与分组RMSNorm等训练优化策略。这种高占比的线性架构,使得整体计算复杂度近似线性,在长上下文条件下,显著降低训练和推理的计算成本。

同时,该模型保持了1/32专家激活率的超稀疏MoE结构,通过MTP(MixtureTokenParallel)与全局负载均衡设计,实现“以6.1B参数模拟40Bdense模型”的效果。在保持性能的前提下,大幅降低激活参数与计算需求。

Ring-linear-2.0系列模型架构示意图,主干结构采用线性Attention与稀疏MoE混合设计,最大支持512K上下文长度,并引入MTP多token预测训练目标。

在真实业务场景中,长文本处理、多轮交互频繁,大模型推理速度慢、成本高成为了其上线部署应用的最大阻碍。正因如此,如何在不牺牲效果的前提下降本提效,成了蚂蚁团队重点探索的方向,而线性Attention与稀疏MoE结合,正是他们给出的答案之一。

二、推理吞吐大幅领先,Prefill、Decode双线提速

当大模型真正部署起来之后,推理吞吐才是决定体验和成本的“临门一脚”。尤其在大模型进入多轮交互、长上下文等复杂场景后,单纯追求更大的参数规模,未必能换来更好的效果,反而可能因吞吐不足拖慢响应、推高成本。因此,Ring-linear系列在推理性能上的表现,成为其能否落地的重要指标。

在推理性能方面,蚂蚁团队提供了详尽实测结果,Ring-linear系列模型在长上下文与高并发生成场景中具备明显优势:

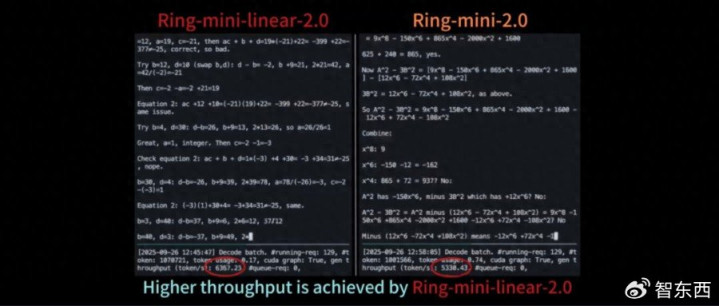

Ring-mini-linear-2.0Prefill吞吐(batchsize=1)

Ring-mini-linear-2.0Decode吞吐(batchsize=64)

Ring-mini-linear-2.0在Prefill阶段(上下文256k+)吞吐量为Qwen3-8B的12倍以上;在Decode阶段,生成长度32k+时吞吐量同样为Qwen3-8B的12倍以上。

Ring-flash-linear-2.0Prefill吞吐(batchsize=1)

Ring-flash-linear-2.0Decode吞吐(batchsize=64)

Ring-flash-linear-2.0则在对比Qwen3-32B时展现出突出优势——上下文32k以上,Prefill阶段吞吐量近5倍;生成长度64k时,Decode阶段逼近10倍吞吐优势。这些优化均得益于蚂蚁团队对推理框架(SGLang/vLLMv1)的深度适配与线性算子的定制化加速。

测试显示,优化后的tritonkernel最高加速比可达2.73倍(prefill单样本任务),在典型decode场景中也能够达到2.57倍,并支持批量prefill与混合推理模式,有效应对真实部署场景中的多并发挑战。

Ring-linear系列在线性Attention算子推理任务中的加速表现

这些优化奠定了Ring-linear系列模型在推理层面的基础。而要将模型真正推进RL训练、提升长期表现,还得解决另一个关键问题:训推一致性。

三、训推一致性修复RL瓶颈,支持长输出下的直接采样

强化学习(RL)阶段的稳定性问题,常常来源于训练-推理(训推)实现不一致。尤其在MoE模型中,组件如RMSNorm、RoPE、Attention、KVCache、softmax等在不同框架间存在精度/顺序/后处理差异,会严重干扰on-policy策略更新,导致reward波动大、训练上限低。

为此,蚂蚁团队从框架底层修正训推逻辑差异,提出三项改进:

1、算子级一致性:训练与推理采用相同模块实现;

2、精度统一:重要模块如KVCache与lm_head统一采用fp32;

3、确定性保障:MOE专家选择、token加和顺序引入稳定排序与固定顺序。

实测显示,修复关键模块后RLreward显著提升,并首次实现RL阶段直接使用rolloutprobs而非trainingprobs,不仅节省重前向计算时间,还提升了训练效率与最终回报。

对比使用rolloutprobs与rainingprobs进行PPOclip训练的效果。左图为训练奖励(Reward)变化趋势,右图为训推概率差异绝对值大于0.8的token占比,对齐后训推差异显著降低。

这一系列修复,为MoE模型走向强化学习阶段扫清了落地障碍,也让长输出任务具备了稳定训练和高质量采样的基础能力。简单来说,就是模型在训练时学会的“策略”,能够在推理时原样执行出来。一旦训推一致,模型就真的学会了“决策”。

四、实测:结构代码生成清晰完整,动画逻辑具备通用性

蚂蚁团队也围绕Ring-linear系列模型进行了多组结构化代码生成的实测,任务涵盖图形动画控制、规则逻辑实现与游戏基础玩法复现。Ring-linear系列模型均可根据自然语言指令输出结构清晰、可直接运行的Python代码,展示出良好的代码理解与生成能力。

实测任务包括:

1、数独游戏web代码生成

指令:“编写一个数独游戏的web应用”

模型生成代码能够快速实现一个bugfree的数独游戏应用,包括正确数字初始化、难易程度选择、数字填写是否正确提示等核心功能。

2、坦克大战

指令:“UsePythontocreateasimplifiedtankbattlegame.Usersusetheup,down,left,andrightkeysonthekeyboardtocontrolthefreemovementofatank.Thespacebarfiresbulletstodefeatenemytanksinthegamescene.Thescenecontainsfivefreelymovingenemytanks,whichfirebull

etsinthedirectionofthecurrenttank’smovement.Eachtimeanenemytankisdefeated,onepointisawarded,andanewenemytankisrandomlygenerated.Thegameendswhentheuser’stankishitbyanenemytank.”

输出Python代码覆盖坦克位置的初始化、方向自动控制、积分更新等完整逻辑模块,能够自主指挥坦克运动和射击。

3、股票系统应用

指令:“请生成一个模拟股票交易软件的页面,数据可以是随机生成的,页面包含了五部分部分:

1.日内的秒级数据,这部分需要一秒更新一次,按照线的方式进行展示。

2.日k线,这部分可以展示最近60天的ohlc的数据,使用蜡烛图进行展示,涨了的是红色,跌了的是绿色。

3.实时的成交量,也是一秒更新一次,现实数字即可。

4.日线的成交量数据,用柱状图表示。

5.公司的介绍,可以随机生成一些。

需要注意的点:

1.请使用canvas绘制各种曲线和蜡烛图,但是需要注意绘制图像的清晰度,需要为高清设备进行准备;

2.需要可以根据窗口的大小自行调整canvas窗口的大小;

3.使用原生的js和html5属性不要使用额外的库;

4.请保证随机生成的价格数据都是可以使用的。”

模型可生成完整的模拟股票交易软件,涵盖交易价格、数量展示、趋势分析等核心功能。同时生成页面展示精美,有较强的指令遵循能力。

整体来看,Ring-linear系列模型在结构化代码生成任务中的表现稳定,具备良好的语义解析与逻辑组织能力,能够覆盖多类Python、Web编程指令,适用于可视化交互、小型逻辑游戏等场景的快速原型生成。

结语:混合线性架构成大模型新风口,百灵团队再打开一扇门

随着推理大模型越来越卷“长推理”“低成本”,TestTimeScaling正在变成新一轮技术追求的焦点。

蚂蚁百灵团队这轮开源的Ring-linear系列模型,结构上“做减法”,用混合线性机制精简计算路径;推理上“做乘法”,依靠稀疏MoE和系统级加速,把效率拉满。不只是跑得快、用得省,更在RL训练这块最难啃的骨头上,给出了全新解法。